ИИ‑помощники уже «умеют говорить». Настоящая ценность — в контексте и контроле

За последние пару лет сделать ИИ помощник стало относительно просто: выбрать модель, набросать промпт, подключить чат на сайт или в приложение. Но на практике бизнес почти сразу упирается не в «умение отвечать», а в три более приземлённые проблемы: что именно знает ассистент, насколько актуальны эти знания и как гарантировать предсказуемое поведение (без галлюцинаций, странных советов, уводов к конкурентам и т. п.).

Именно поэтому ключевой актив современного решения — не «чат», а управление контекстом: какие источники считаются правдой, как они обновляются, как ограничивается свобода модели и что происходит, когда данных нет.

Почему «контекст» в ИИ помощнике важнее промпта

LLM по природе вероятностная: если ей не дать проверяемую опору, она будет достраивать ответ «как похоже». Для бизнеса это выглядит как галлюцинации: выдуманные условия доставки, несуществующие товары, неверные цены. Поэтому задача смещается к гибридному подходу:

- контекст и знания формируются из ваших источников (каталог, FAQ, политики, инструкции);

- модель получает только нужную выдержку и отвечает строго в рамках разрешённых правил.

В Riserlabs этот подход реализован как сервис: вы добавляете источники (URL или файлы), система их извлекает и периодически синхронизирует, чтобы ответы оставались «приземлёнными» и актуальными.

Что обычно делает внедрение дорогим — и как сократить путь до результата

Классический путь «в лоб» — строить собственную RAG‑инфраструктуру: пайплайны загрузки данных, векторные базы, ранжирование, мониторинг качества, защита, логирование, контроль затрат. Это долго и дорого, особенно если вы ещё не уверены в конверсии.

Вместо этого Riserlabs предлагает быстрый запуск ИИ виджет или подключение через API: вы встраиваете виджет на сайт, добавляете 1–2 источника и тестируете на реальных пользователях. Платформа прямо позиционируется как способ проверить гипотезу дешевле, чем строить RAG, а затем масштабировать сценарии и ограничения.

Контроль поведения: чтобы ИИ продавец продавал, а ИИ поддержка — помогала

Даже идеально наполненные знания бесполезны, если ассистент «ведёт себя как хочет». Поэтому важны:

- Персона и правила: тон, границы, политика отказов, насколько строго следовать контексту. Это помогает сделать из ассистента управляемого ИИ продавец или аккуратную ИИ поддержка, а не «болталку».

- Контролируемые действия (CTA): кнопки и следующие шаги настраиваются в панели и исполняются сервер‑сайд, что снижает риск prompt‑injection и «самодеятельности» модели.

- Безопасность и анти‑бот: allowlist доменов, CAPTCHA, лимиты, шифрование сообщений и предсказуемые расходы — то, без чего B2B‑внедрения обычно разваливаются на проде.

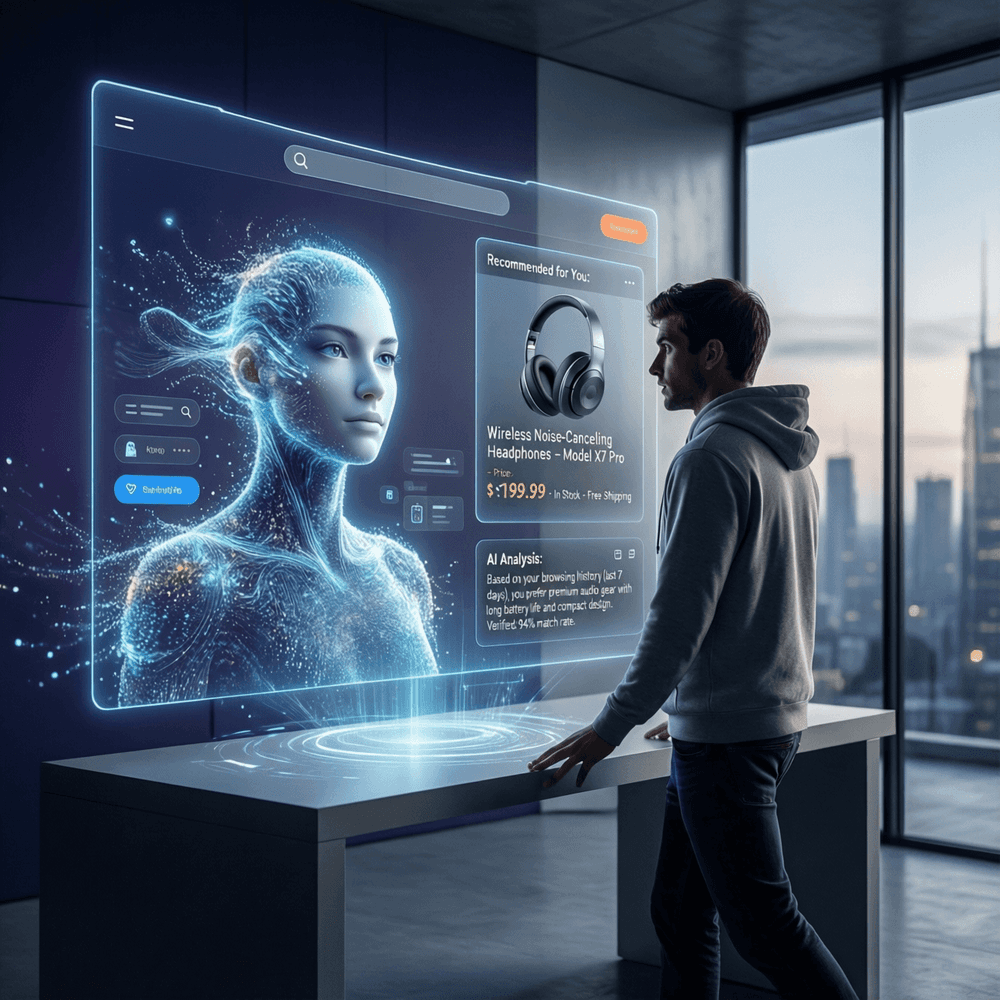

Пример: интернет‑магазин с актуальными товарами, ценами и сравнением

Один из самых показательных кейсов — e‑commerce. Вместо «обучения модели» на всём подряд вы подключаете каталог как источник: URL/файлы, а также YML‑фиды, которые можно использовать как источник каталога.

На практике это удобно для связки с выгрузками из Bitrix/Shopify/WooCommerce: каталог регулярно обновляется, и ассистент отвечает по данным, которые вы ему дали — сравнивает товары, опирается на текущие позиции и ведёт пользователя к покупке без выдумок.

Если свести всё к одной мысли: сегодня конкурентоспособен не тот, у кого «просто есть чат», а тот, кто умеет быстро и безопасно собрать контекст, удержать его актуальным и заставить ассистента действовать предсказуемо. Именно это и позволяет запускать ИИ‑ассистента на базе riserlabs.io за считанные десятки минут — без самостоятельного строительства тяжёлой инфраструктуры и бесконечных итераций «почему он опять галлюцинирует».